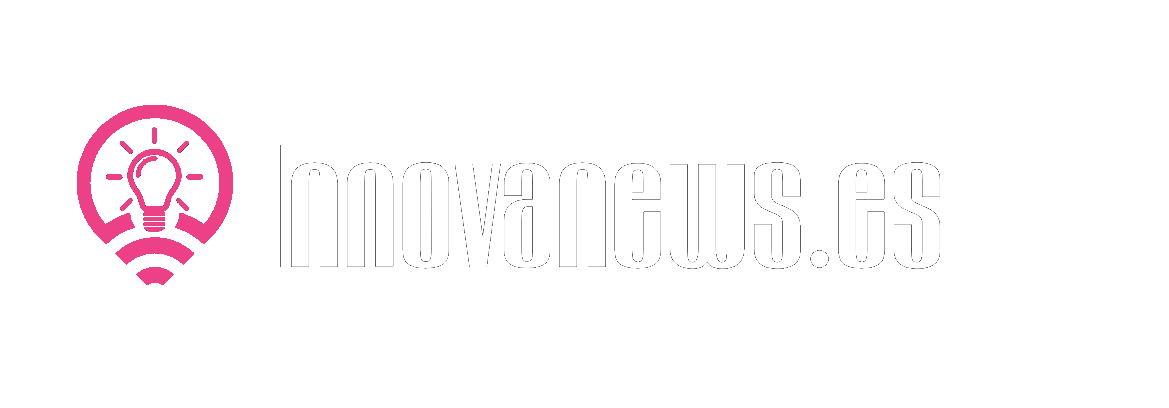

Europa ha dado un paso decisivo hacia la regulación de la inteligencia artificial al introducir una legislación pionera que promueve el uso ético de esta tecnología. Con la adopción de la nueva ley, se busca garantizar la seguridad, la transparencia y la confianza en el uso de la IA en territorio europeo. Empresas grandes y pequeñas deben estar preparadas para adaptarse a este cambio regulatorio que entrará en vigencia en 2025, y que aplica sanciones severas por incumplimiento. Comprender cómo estas regulaciones impactarán el uso de la IA es clave para evitar sanciones significativas.

Índice

ToggleEuropa y la régulación de una ia ética

Con el reciente avance en la legislación sobre inteligencia artificial en Europa, la región se ha posicionado como un verdadero pionero en el desarrollo de criterios éticos para las nuevas tecnologías. La nueva legislación que comenzará a regir a partir de 2025 tiene como objetivo garantizar que las aplicaciones de IA en empresas europeas sean transparentes, seguras y eficientes, limitando su uso en áreas consideradas sensibles, como el reconocimiento facial y la detección de emociones. Esta acción intencionada por parte de la Unión Europea tiene como propósito crear un ecosistema seguro y confiable que priorice el bienestar de sus ciudadanos.

Cómo afecta la nueva legislación a las empresas

A partir de febrero de 2025, las empresas que utilizan sistemas de inteligencia artificial en Europa se enfrentarán a regulaciones más estrictas. Los sectores que se consideran de alto riesgo, como el manejo de datos personales en campañas de reclutamiento y estrategias publicitarias, deberán cumplir con pautas específicas de transparencia y seguridad. Las empresas deberán mostrar que sus sistemas de IA están dirigidos por humanos y no contienen sesgos discriminatorios que puedan afectar negativamente a la interacción humana. En caso de incumplimiento, las sanciones serán severas, lo que resalta la importancia de la conformidad.

Restricciones adicionales para proveedores de sistemas de IA

En un esfuerzo por mitigar riesgos potenciales, la legislación también afecta a los proveedores de sistemas de IA considerados de alto riesgo. Estos deberán cumplir con una serie de medidas preventivas para evitar fallos en el sistema y garantizar la fiabilidad de los datos manejados. Cada sistema comercializado deberá estar documentado exhaustivamente, detallando su funcionamiento y objetivos, garantizando que esté bajo el control humano y sea modificable en caso de decisiones automatizadas. Esta regulación establece un nuevo estándar en Europa, demostrando su compromiso con una IA ética y responsable.